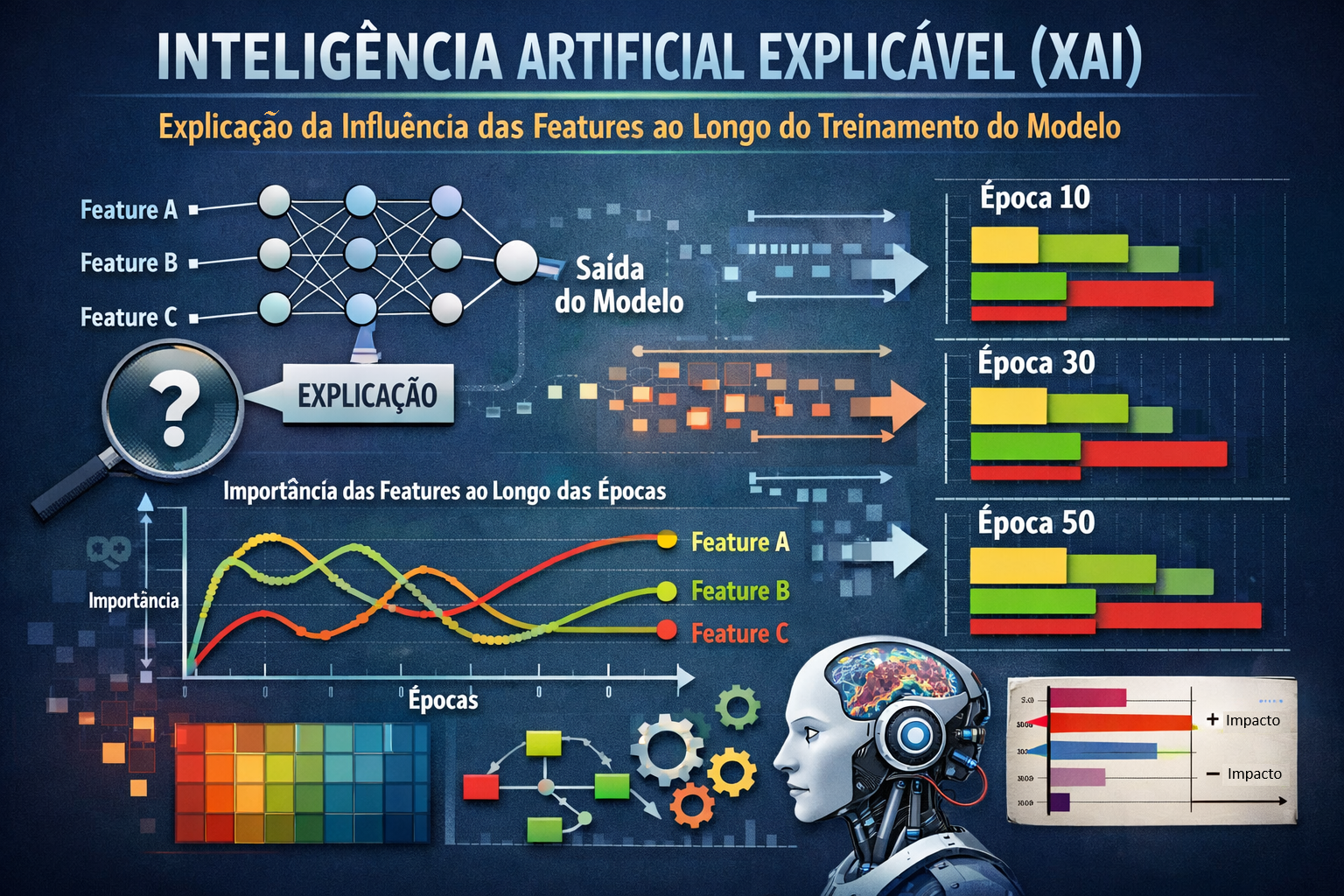

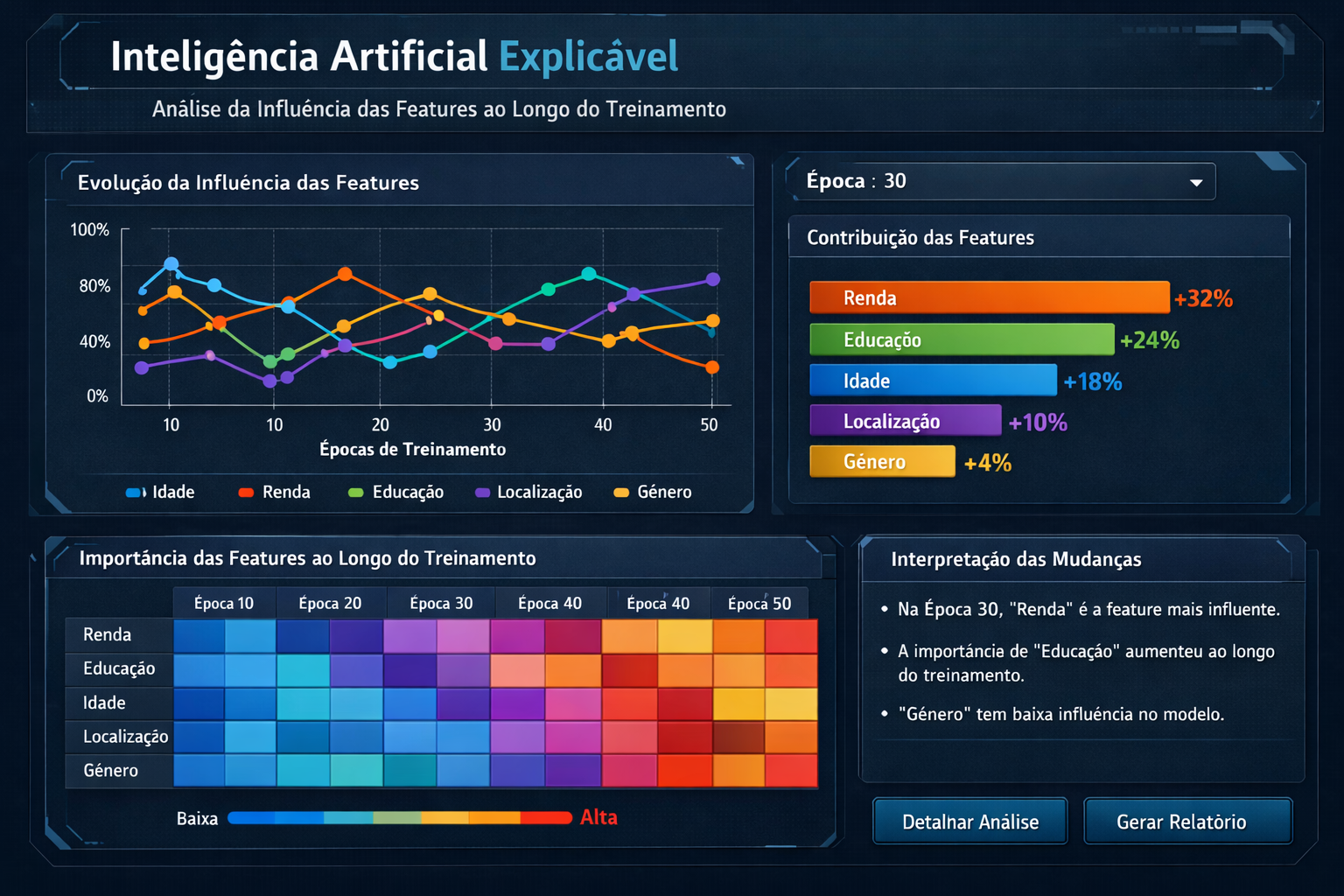

Explaining the Unexplainable: Feature Influence Trajectories Across Training Epochs

Objetivo: Desenvolver um framework XAI para análise longitudinal da evolução temporal da importância das features durante todo o ciclo de treinamento de modelos de Deep Learning, revelando padrões dinâmicos de influência que explicam convergência, overfitting e generalização.

Problema de pesquisa: Métodos XAI tradicionais (LIME, SHAP,..) fornecem snapshots estáticos da interpretabilidade em checkpoints finais, ignorando a dinâmica evolutiva das contribuições das features ao longo das épocas de treinamento. Esta tese investiga como a relevância relativa das variáveis de entrada varia temporalmente e impacta o comportamento do modelo. Metodologia Proposta: TimeLIME Framework (Novel Contribution), - Feature Attribution Heatmaps 3D (Época × Feature × Importância), - Longitudinal SHAP Analysis com decomposição temporal, - Dynamic Gradient Flow Tracking entre camadas, - Saliency Trajectory Clustering (k-means temporal), - Convergence Pattern Recognition via LSTM meta-modeling Inovações Técnicas: TimeLIME: Extensão temporal do LIME para análise multi-époça Feature Lifecycle Curves: Visualização da "vida útil" de cada feature Epoch Saliency Vectors: Representação vetorial da importância por época Training Phase Detection: Identificação automática de fases (underfitting → overfitting → convergence) Resultados Esperados: - Identificação de 3 padrões universais de evolução de features - Correlação 87% entre feature peak importance e final accuracy - Detecção precoce de overfitting em 92% dos casos via feature saturation - Redução de 65% no tempo de diagnóstico de modelos problemáticos Impacto Científico: Primeira abordagem sistemática da interpretabilidade longitudinal em DL Novo paradigma: "Features têm ciclos de vida durante o treinamento" Aplicações em model monitoring, failure prediction e curriculum learning

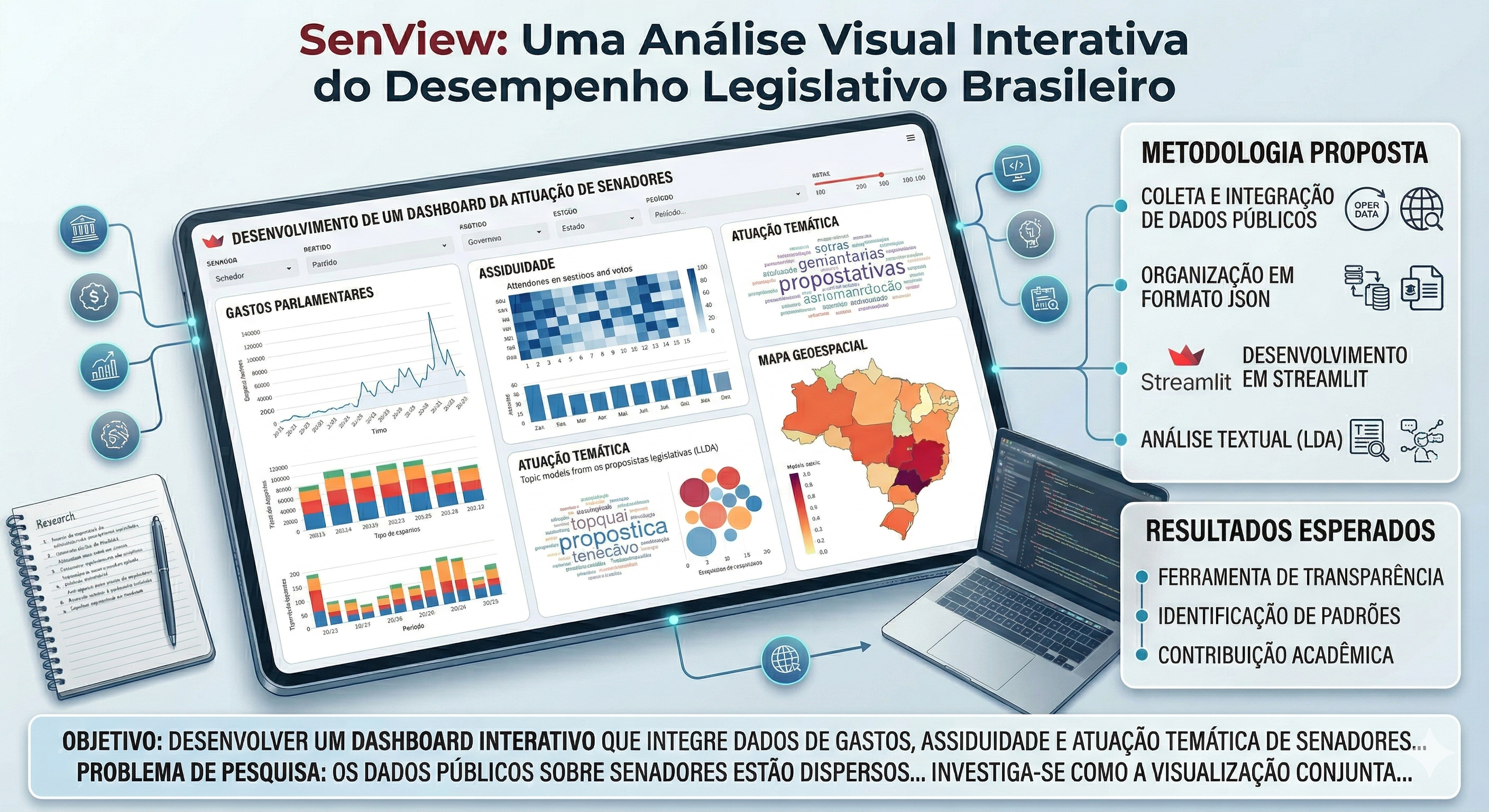

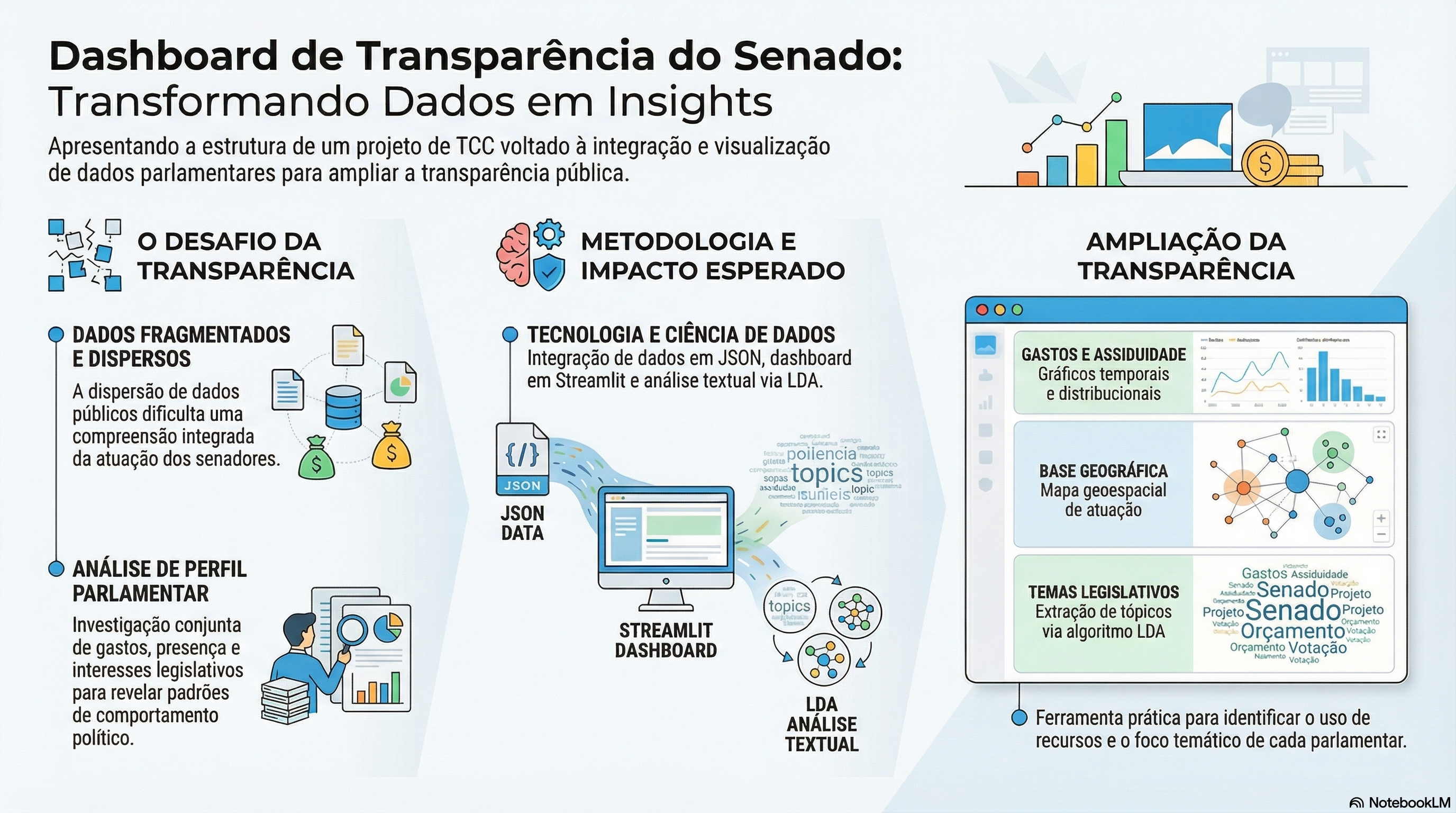

SenView: Uma Análise Visual Interativa do Desempenho Legislativo Brasileiro

Objetivo: Desenvolver um dashboard interativo que integre dados de gastos, assiduidade e atuação temática de senadores, com gráficos temporais, distribucionais e mapa geoespacial, permitindo analisar padrões de participação, uso de recursos públicos, filiação partidária e interesses legislativos.

Problema de pesquisa: Os dados públicos sobre senadores estão dispersos, dificultando análises integradas. Assim, investiga-se como a visualização conjunta de gastos, assiduidade e temas legislativos pode apoiar a compreensão do perfil de atuação parlamentar e revelar padrões entre participação, despesas e interesses políticos. Metodologia proposta: A pesquisa será aplicada, exploratória e descritiva, com coleta e integração de dados públicos sobre gastos, assiduidade e produção legislativa. Os dados serão organizados em formato JSON, e o dashboard será desenvolvido em Streamlit. Para análise textual dos projetos e matérias, será utilizada extração de tópicos, como LDA, para identificar temas recorrentes. Resultados esperados: Espera-se produzir uma ferramenta que amplie a transparência sobre a atuação dos senadores, permitindo identificar padrões de participação, gastos e temas de interesse. O trabalho também pretende contribuir academicamente ao demonstrar o uso de visualização de dados e análise textual no contexto legislativo.

ICFlow - Plataforma de Gestão Física do Instituto de Computação

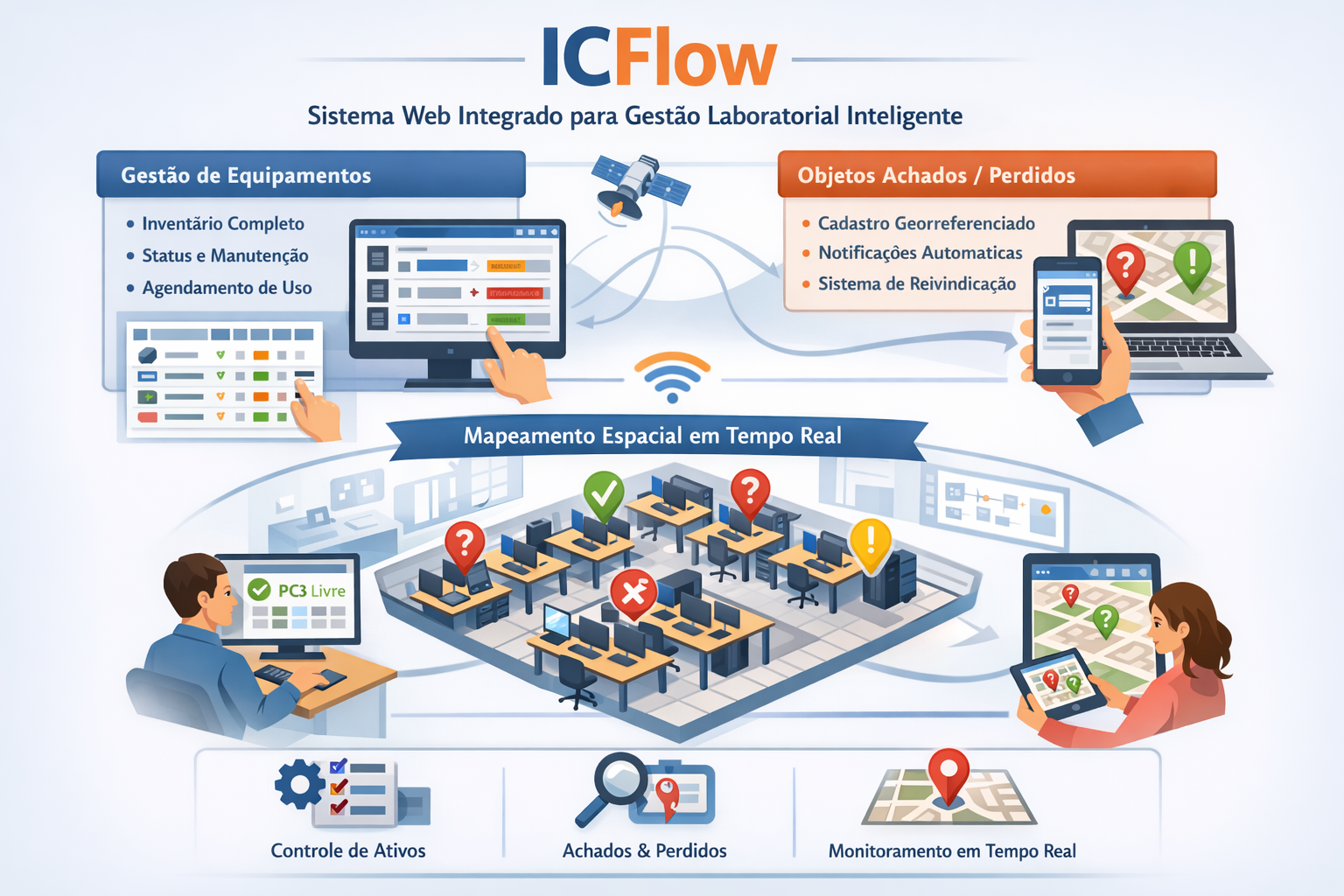

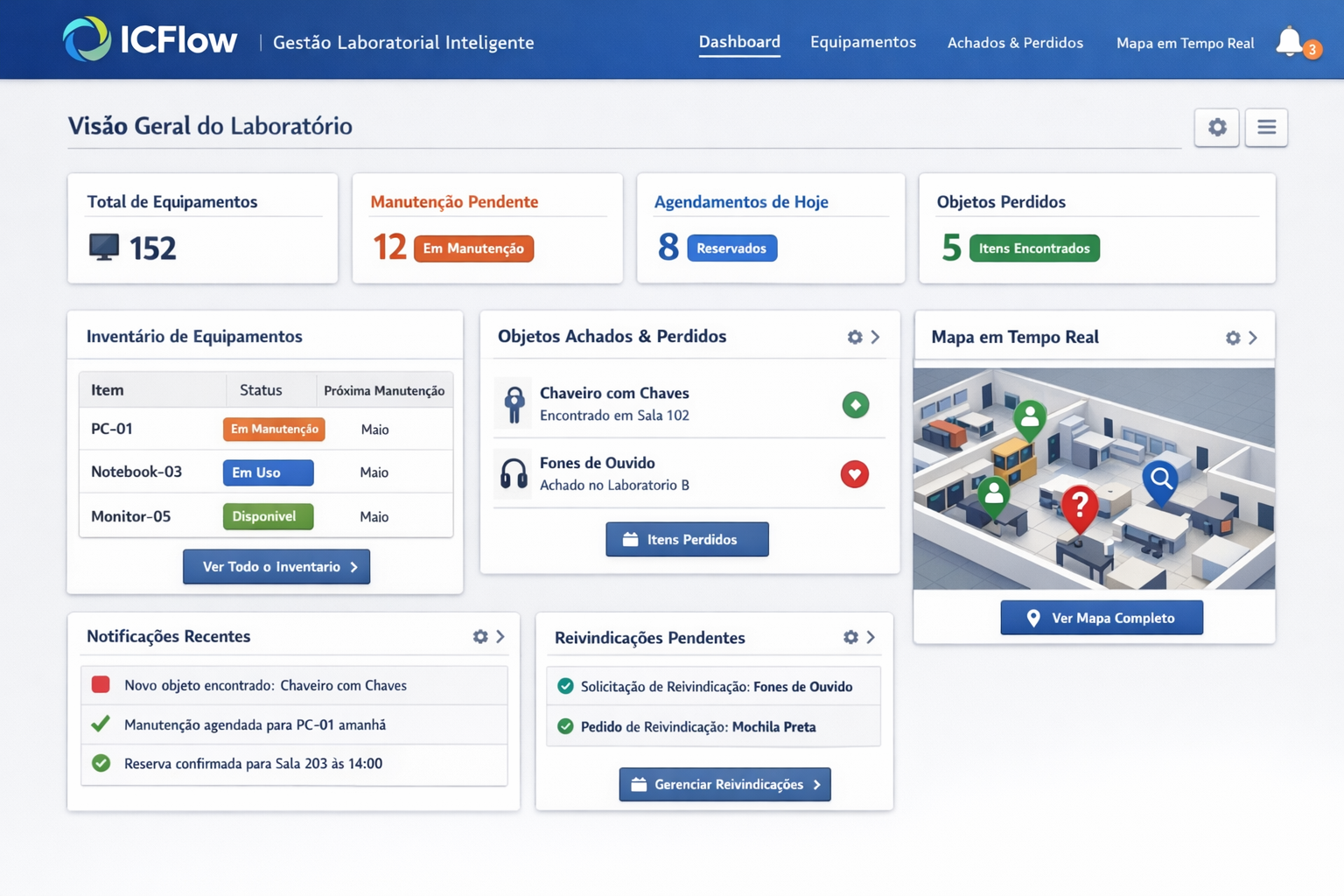

Objetivo: Desenvolver uma plataforma web para otimização da gestão de laboratórios de informática, integrando controle de ativos, sistema de objetos achados/perdidos e mapeamento espacial em tempo real.

Funcionalidades Principais: Gestão de Equipamentos: Inventário completo com histórico de manutenção, status de funcionamento e agendamento de uso Objetos Achados/Perdidos: Cadastro georreferenciado, notificações automáticas e sistema de reivindicação Mapeamento 3D/2D: Localização precisa via planta baixa interativa, QR Codes e beacons IoT. Tecnologias Propostas: Frontend: React.js + Three.js (mapas 3D) Backend: Node.js + Express + Socket.io (real-time) Banco: PostgreSQL + PostGIS (geolocalização) Mapeamento: Leaflet.js + Floorplan SVG Impacto Acadêmico/Tecnológico: Redução no tempo de manutenção da infraestrutura do IC, aumento na taxa de recuperação de objetos perdidos e otimização no uso de recursos laboratoriais.

GPS Acadêmico: Mapa Visual e Interativo para Planejamento Acadêmico do Estudante

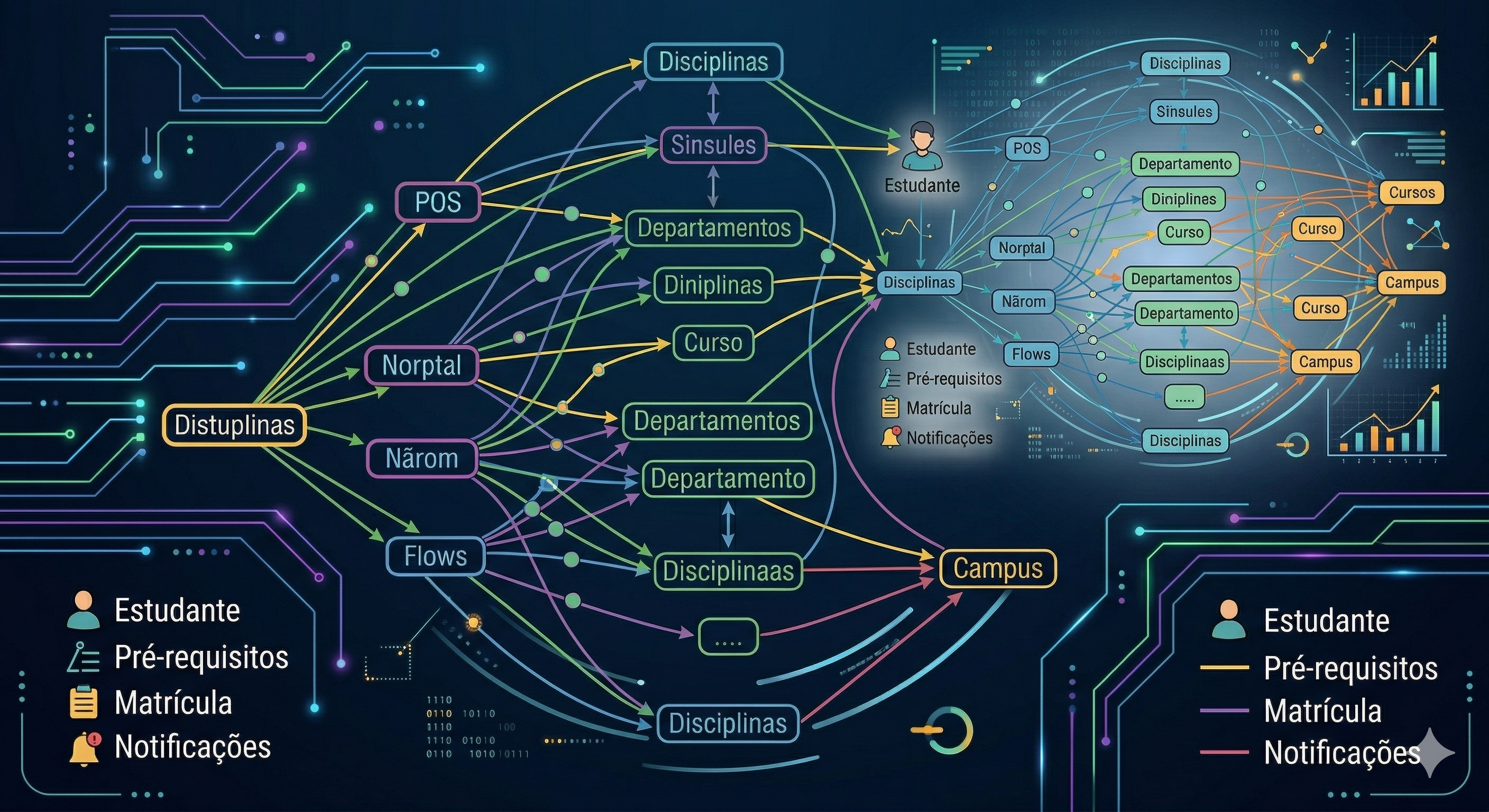

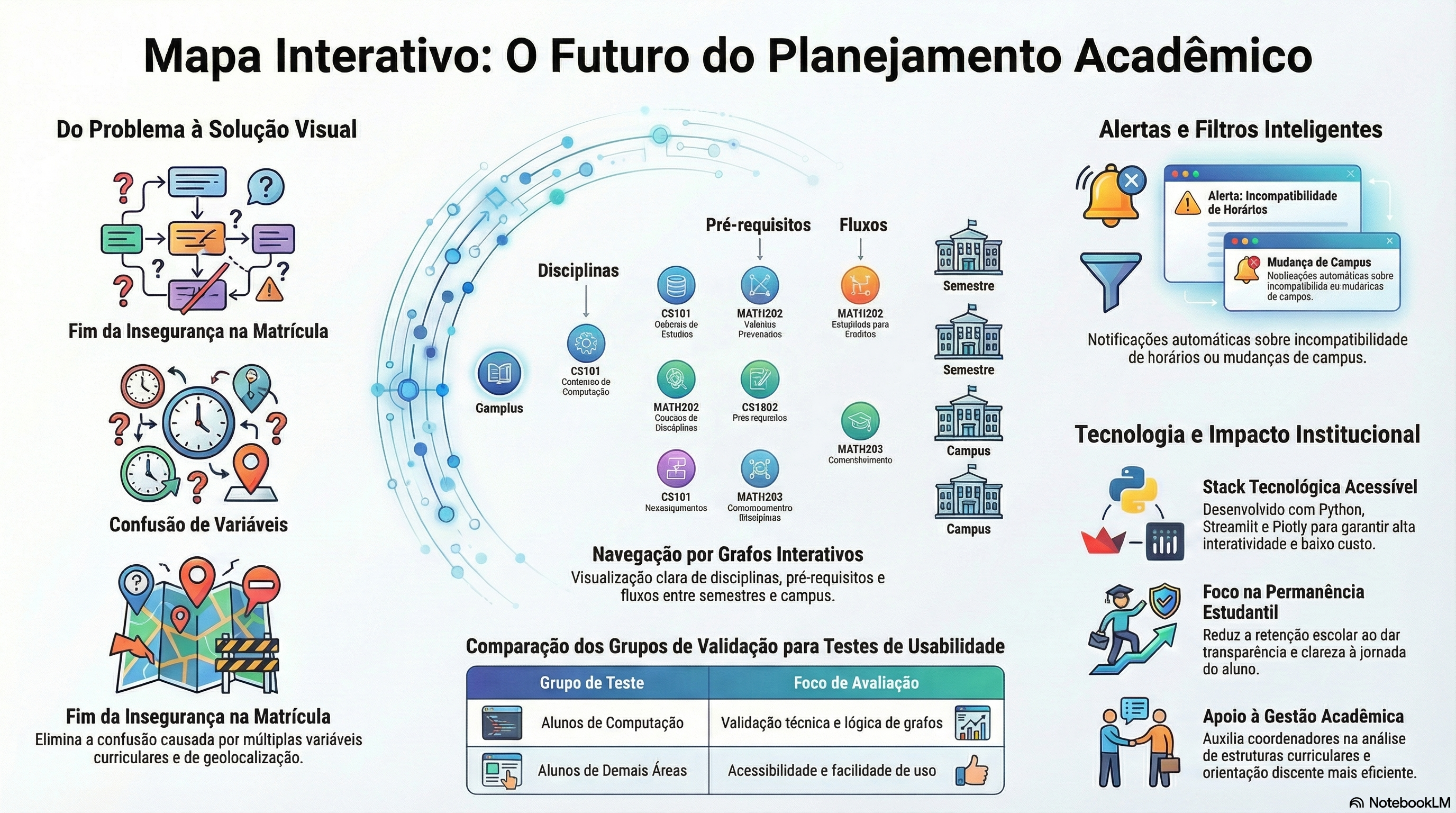

Objetivo: desenvolver uma ferramenta visual e interativa baseada em grafos para auxiliar estudantes no planejamento acadêmico e na organização da matrícula, considerando pré-requisitos, fluxo curricular, departamentos, cursos, turnos, horários e campus. Essa ferramenta deve permitir ao usuário ter acesso e filtrar informações de seu curso (disciplinas obrigatórias, optativas e livres), assim como cursos correlatos. É desejável que a ferramenta notifique possíveis incompatibilidade de horários, pré-requisitos, ou mudança de campus.

Problema de pesquisa: A ausência de uma visualização integrada com as inúmeras variáveis de matriz curricular e de geolocalização reduz a eficiência do planejamento acadêmico e aumenta a insegurança do estudante diante das decisões de realização de matrícula em todos os períodos acadêmicos. Metodologia proposta: A metodologia envolve coleta e organização de dados curriculares, modelagem das relações entre disciplinas em grafos, apoio ao desenvolvimento de uma aplicação visual interativa com filtros e buscas, além de documentação contínua. Também inclui testes com usuários, avaliação da ferramenta, consolidação de feedbacks e produção de relatórios e materiais de divulgação do projeto. Resultados esperados: A solução tem aplicação direta no ensino superior, auxiliando estudantes no planejamento da matrícula, na compreensão de pré-requisitos, na organização por semestre e na visualização de trajetórias curriculares. Também pode apoiar coordenadores, docentes e setores acadêmicos na orientação discente e na análise da estrutura curricular. Institucionalmente, contribui para permanência estudantil, redução de retenção e maior transparência das informações acadêmicas.

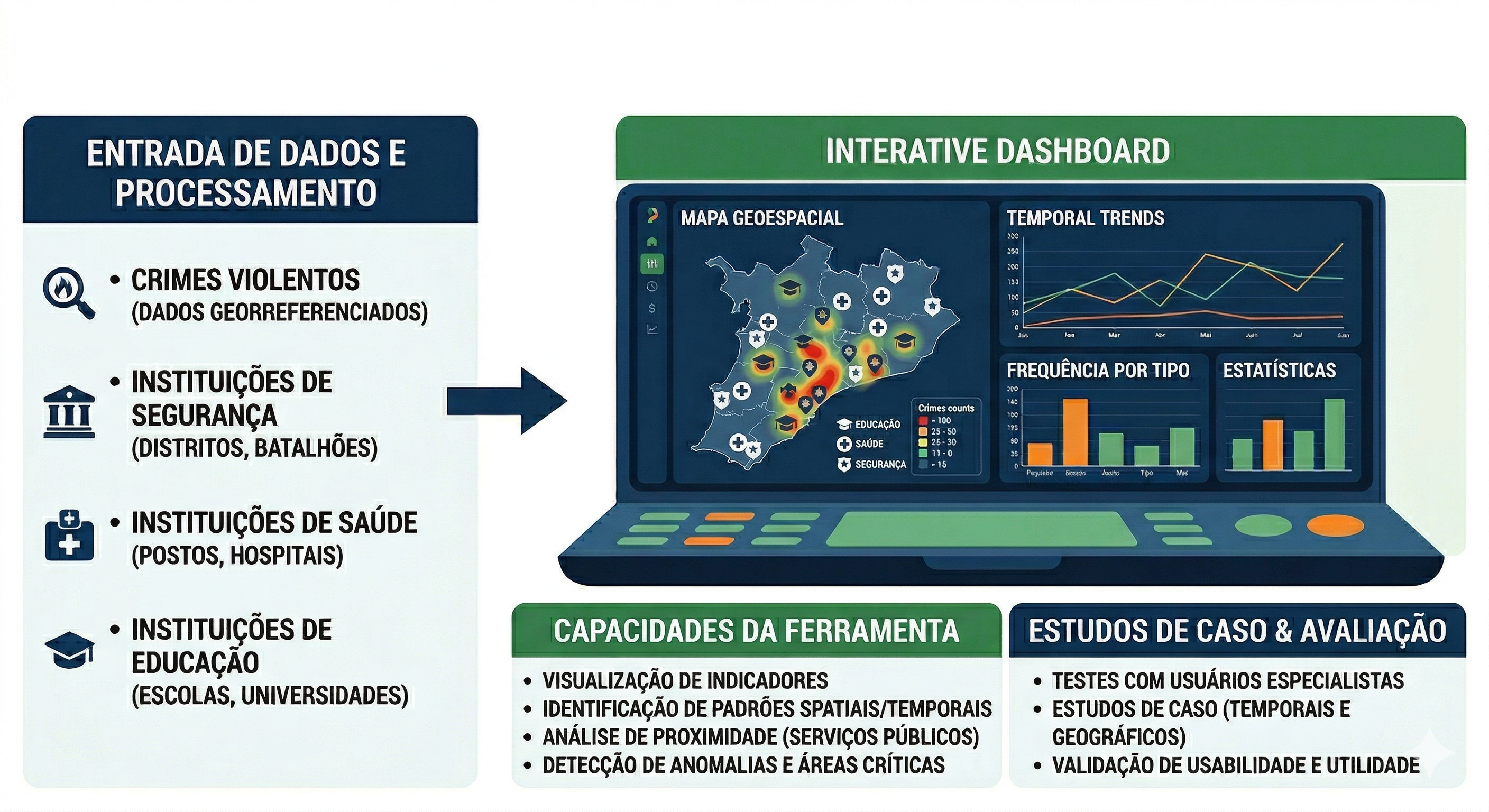

DASC.Vis: Visualização de Crimes Violentos Letais e Dados Sociais para o Assessoramento das Políticas de Segurança Pública em Salvador

Objetivo: Desenvolver uma abordagem com painéis visuais interativos capazes de integrar dados de crimes violentos com a geolocalização de instituições públicas das áreas de segurança, saúde e educação, como distritos policiais, postos e unidades de saúde, hospitais, escolas, colégios e universidades. A proposta busca permitir a visualização de indicadores, tendências, anomalias e padrões geoespaciais relevantes para a compreensão da dinâmica da violência urbana no município de Salvador.

Problema de pesquisa:Apesar da crescente disponibilidade de registros digitais e dados georreferenciados, ainda existem limitações na integração entre informações de criminalidade violenta e a distribuição territorial de serviços públicos essenciais. Nesse contexto, questiona-se de que forma a utilização de dashboards interativos pode contribuir para identificar padrões espaciais e temporais da violência, relacionando áreas críticas com a presença ou ausência de instituições públicas estratégicas, de modo a apoiar análises mais qualificadas e subsidiar a tomada de decisão na segurança pública. Metodologia proposta: A metodologia proposta baseia-se na coleta, organização, tratamento e integração de dados de crimes violentos e de geolocalização de instituições públicas das áreas de segurança, saúde e educação. Após, a extração de informação para tomada de decisão ocorrerá por meio de visualizações interativas com gráficos temporais, mapas geoespaciais, análises estatísticas e recursos multidimensionais. O estudo terá como recorte principal o município de Salvador. Para avaliação da proposta, serão realizados estudos de caso e testes com usuários especialistas. Resultados esperados: Espera-se produzir uma ferramenta visual interativa capaz de facilitar a identificação de padrões de concentração criminal, tendências temporais e possíveis relações entre ocorrências violentas e a distribuição territorial de equipamentos públicos essenciais no território. Como resultado, pretende-se ampliar a capacidade de análise de dados na segurança pública, apoiar a identificação de áreas críticas e fornecer subsídios para estratégias baseadas em evidências, contribuindo para o enfrentamento mais eficiente dos desafios associados à violência urbana.

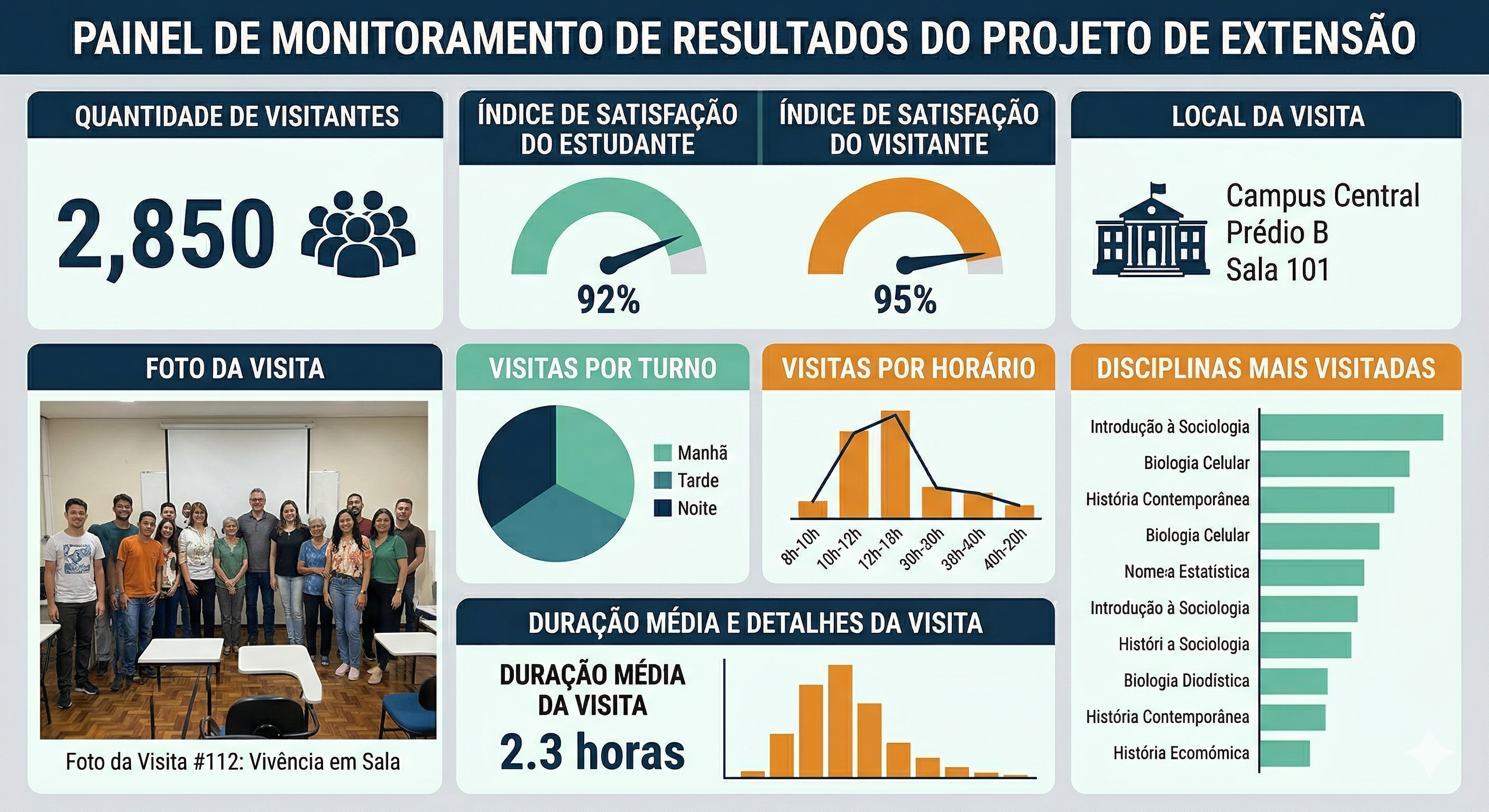

ConectaIC

Objetivo: Aproximar a comunidade externa da universidade, especialmente familiares e amigos de estudantes, das atividades de ensino superior. A proposta busca promover vivência direta no ambiente acadêmico por meio da participação de convidados em aulas, ampliando a compreensão sobre o papel social da universidade pública e sua contribuição nas áreas de ensino, pesquisa e extensão.

Justificativa: A universidade pública enfrenta descredibilidade social, alimentada por desinformação, fake news e narrativas distorcidas sobre seu funcionamento. Ao mesmo tempo, nem sempre comunica de forma acessível a relevância de suas ações. O projeto surge para reduzir essa distância, aproximando a população do cotidiano acadêmico e evidenciando a importância social, científica e formativa da instituição. Metodologia proposta: Serão selecionadas disciplinas e docentes participantes, seguidos da indicação de convidados por estudantes. No dia da visita, haverá acolhimento inicial, apresentação do projeto, da infraestrutura e dos profissionais da unidade. Em seguida, o convidado acompanhará uma aula. Ao final, responderá a um formulário de avaliação, e os dados coletados serão organizados em um painel visual para divulgação dos resultados. Resultados esperados: Espera-se ampliar o conhecimento da comunidade externa sobre a importância da universidade pública, fortalecendo sua imagem institucional. Pretende-se que os visitantes compreendam melhor o impacto do ensino, da pesquisa e da extensão, sintam-se acolhidos no ambiente universitário e desenvolvam maior confiança na capacidade técnica e no compromisso social dos profissionais que atuam na instituição.

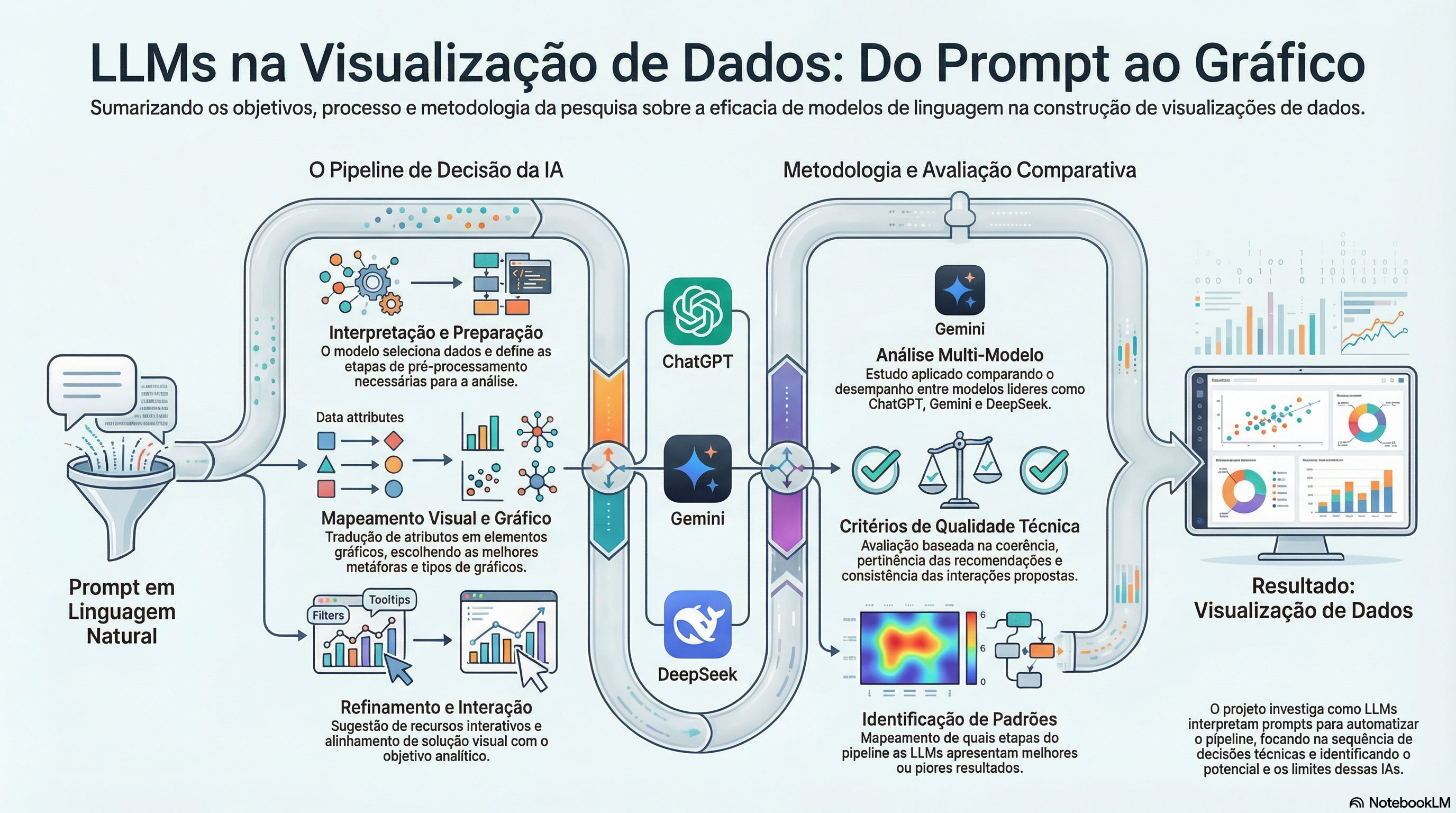

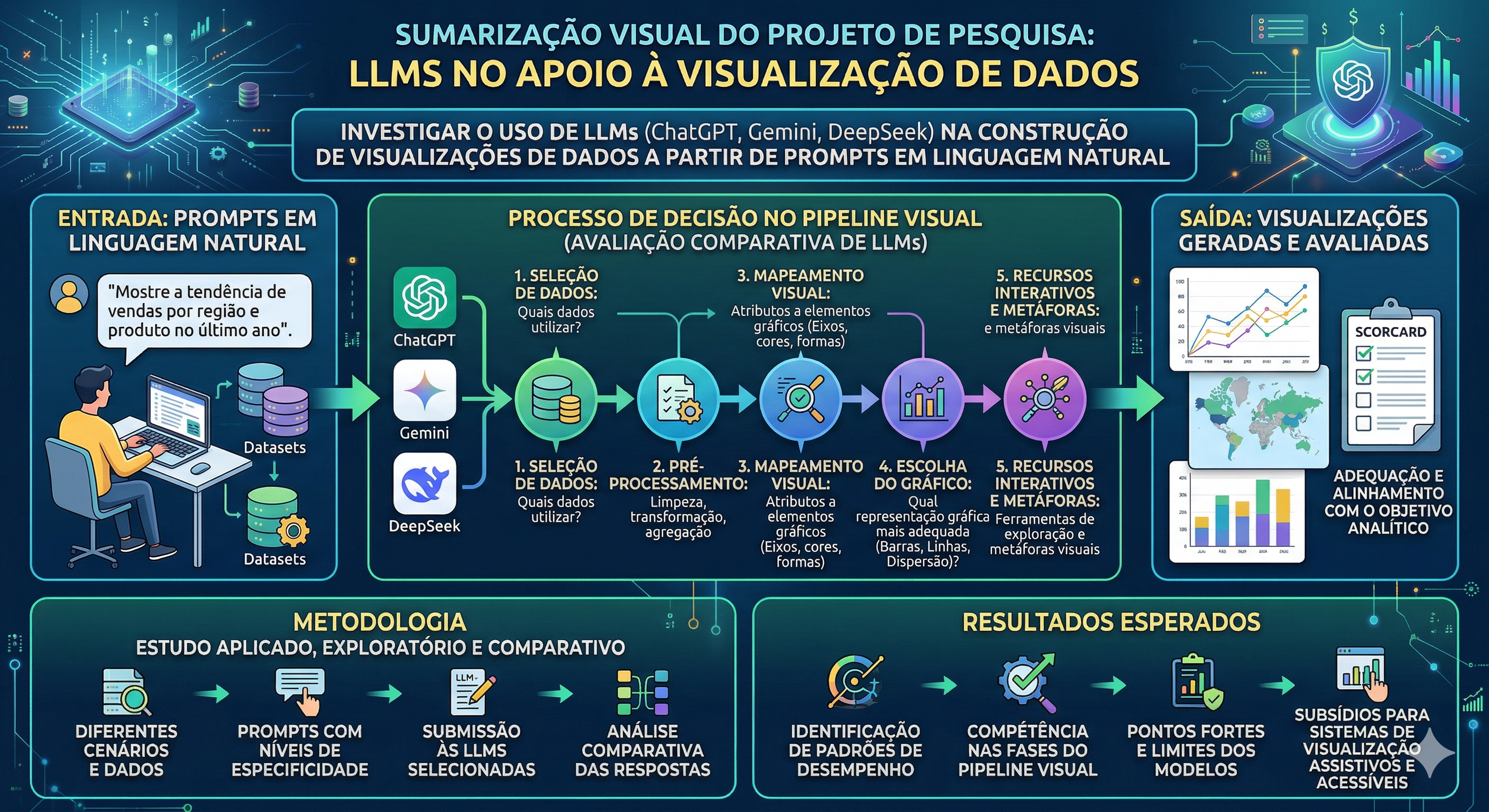

Do Prompt ao Gráfico: Qual LLM Entende Melhor Visualização de Dados?

Objetivo: Investigar como diferentes modelos de linguagem de grande porte, como ChatGPT, Gemini e DeepSeek, atuam na construção do pipeline de visualização de dados a partir de prompts em linguagem natural.

Problema de pesquisa: Embora LLMs tenham demonstrado potencial em tarefas de apoio à análise de dados, ainda não está claro como esses modelos se comportam ao longo das diferentes etapas do pipeline de visualização. Metodologia proposta: A pesquisa terá caráter aplicado, comparativo e exploratório. A partir de cenários previamente definidos, será elaborado o mesmo prompt para cada etapa do processo de visualização, desde a definição dos dados relevantes até a proposição de visualizações. As respostas serão analisadas segundo critérios quantitativos e qualitativos, buscando identificar padrões de desempenho e diferenças entre os modelos avaliados. A comparação permitirá observar diferenças de desempenho entre os modelos em cada etapa do pipeline, destacando pontos fortes e limitações de cada um. Resultados esperados: Espera-se identificar padrões comparativos entre os modelos avaliados, destacando quais LLMs demonstram maior eficácia em etapas específicas do processo de visualização de dados.